五大前沿科技共振:从AI Agent到太空基建的算力基础设施硬件设备解析

时间:2026-03-15 03:54:42

来源:UltraLAB图形工作站方案网站

人气:51

作者:管理员

——解析木头姐"大加速"理论下的高性能计算架构设计

当Cathie Wood(木头姐)在《Big Ideas 2026》中提出"大加速"(Great Acceleration)概念时,她指出的不仅是技术周期的更迭,更是一场由算力驱动的经济范式重构。AI、多组学、可回收火箭、无人驾驶与机器人技术五大平台的共振,正在将人类基因组测序成本从30亿美元压缩至10美元,将火箭发射成本降低95%,将AI任务处理时长从5分钟延长至55分钟以上。

在这场技术革命背后,有一个被低估的核心变量:算力基础设施的架构设计。本文将从算法原理、计算特征、软件生态到硬件配置,深度剖析支撑下一轮技术革命的工程实现路径。

一、AI Agent:从对话工具到长线执行者的架构跃迁

关键技术特征

当前AI正经历从"短时响应"到"长线执行"的根本性转变。ARK数据显示,AI Agent可稳定处理任务的时长已从2023年的5分钟跃升至2025年的55分钟以上,这要求计算架构支持超长上下文窗口(Long Context Window)与思维链推理(Chain-of-Thought Reasoning)。

核心算法栈:

-

Transformer架构演进:从GPT-4到Claude 3.5,基于MoE(混合专家)的稀疏激活网络成为主流,需要在推理阶段动态路由至不同专家子网络

-

ReAct推理框架:结合推理(Reasoning)与行动(Acting)的循环决策机制,要求低延迟的工具调用(Tool Use)接口

-

合成数据生成:模型自我迭代训练依赖高质量的合成数据流水线,涉及Diffusion Model与GAN的混合计算

计算特点分析

AI Agent的部署呈现"训练集中化,推理边缘化"的趋势:

-

内存带宽瓶颈:长上下文推理对HBM3e显存带宽提出极高要求(≥1TB/s),KV-Cache管理机制决定响应延迟

-

混合精度计算:FP8/INT8量化推理与FP32训练精度要求的动态切换,需要硬件支持细粒度精度控制

-

实时性要求:企业级Agent要求P99延迟<100ms,涉及复杂的批处理(Batching)与连续批处理(Continuous Batching)策略

软件工具链

# 典型AI Agent开发栈 基础框架:PyTorch 2.0+ / JAX / TensorFlow

推理引擎:vLLM / TensorRT-LLM / Text Generation Inference

Agent框架:LangChain / AutoGen / Semantic Kernel

向量数据库:Pinecone / Milvus / Weaviate(支持RAG检索增强)

监控工具:Weights & Biases / MLflowUltraLAB硬件配置方案

场景A:大模型微调与Agent训练(科研/企业级)

-

机型:UltraLAB GX660M 深度学习工作站

-

CPU:2× Intel Xeon Platinum 8592+(128核/256线程,3.0GHz睿频)——支撑数据预处理与特征工程的高并发需求

-

GPU:4× NVIDIA RTX Pro 6000 Blackwell(96GB显存/卡)——支持Llama 3-70B级别模型的全参数微调

-

内存:2TB DDR5-4800 ECC——容纳长序列的KV-Cache与批量训练数据

-

存储:30TB NVMe SSD RAID5(读取速度≥20GB/s)——满足海量合成数据实时加载

-

网络:双端口100GbE InfiniBand——支持分布式训练中的梯度同步

场景B:边缘侧AI Agent推理(低延迟部署)

-

机型:UltraLAB PE450 紧凑型推理工作站

-

CPU:AMD Ryzen Threadripper 7985WX(64核,5.1GHz睿频)——高主频支撑单线程Agent决策逻辑

-

GPU:2× RTX 4090(24GB显存)——INT8量化推理性价比最优解

-

内存:256GB DDR5——本地向量数据库驻留

-

专用加速:NVIDIA ConnectX-6 SmartNIC(卸载网络协议栈,降低推理延迟)

二、多组学(Multiomics):AI驱动的生命科学数据洪流

技术原理与算法

基因组学正成为"地球上最大的数据生成引擎"。当单细胞测序(scRNA-seq)技术能够解析35-40万亿个细胞的基因表达时,数据维度呈现超指数级增长。

核心算法挑战:

-

序列比对算法:BWA-MEM、Minimap2等工具需要处理PB级FASTQ数据,涉及Suffix Array与FM-index的内存密集型计算

-

变异检测(Variant Calling):GATK HaplotypeCaller基于PairHMM的隐马尔可夫模型计算,单样本即需数百核时

-

单细胞聚类分析:Scanpy/Seurat包中的Leiden/Louvain社区发现算法,在百万级细胞数据集上呈现O(n²)复杂度

-

AlphaFold3结构预测:基于Transformer的蛋白质结构建模,需要处理三维空间中的等变几何关系(E(3)-equivariance)

计算特征

-

内存密集型:人类基因组参考序列仅3GB,但比对过程的BAM文件可达数TB,需要大内存(≥1TB)避免磁盘交换

-

IO密集型:测序数据从Illumina NovaSeq X Plus流出速度达10TB/天,要求存储带宽≥20GB/s

-

异构计算:Basecalling(碱基识别)阶段需GPU加速(CUDA加速的Dorado算法),而变异注释阶段依赖CPU单线程性能

软件生态

# 生物信息学核心工具栈 测序分析:BWA, Bowtie2, Minimap2, Dorado (ONT basecalling) 变异检测:GATK, DeepVariant (Google AI), Samtools

单细胞分析:Cell Ranger, Scanpy, Seurat, Monocle3

结构预测:AlphaFold3, ColabFold, OpenFold

流程管理:Snakemake, Nextflow (支持云端弹性扩展) 可视化:IGV (Integrative Genomics Viewer)硬件配置方案

场景C:基因组学数据中心(多组学分析平台)

-

机型:UltraLAB ClusterCluster Gmax668 生信分析集群

-

计算节点:8× 双路AMD EPYC 9755(128核/节点,总计1024核)——应对群体基因组学的并行比对任务

-

GPU加速节点:4× NVIDIA H100 80GB——专门用于AlphaFold3蛋白质结构批量预测与深度学习变异检测模型训练

-

内存配置:每节点1TB DDR5,总内存8TB——支持千人基因组计划的联合 calling(Joint Calling)

-

并行存储:WEKA FileSystem / Lustre并行文件系统,200TB可用容量,聚合带宽50GB/s——应对多组学数据的并发读写风暴

-

网络架构:NVIDIA Quantum-2 InfiniBand NDR(400Gb/s)——确保跨节点MPI通信无阻塞

场景D:精准医疗边缘计算(医院/研究所本地化部署)

-

机型:UltraLAB PR350 静音生信工作站

-

CPU:AMD Ryzen 9 9950X(16核,5.7GHz)——单核性能优先,加速GATK单样本分析

-

GPU:RTX 6000 Ada 48GB——本地运行中等规模AlphaFold2推理

-

存储:8TB NVMe SSD(企业级U.2接口)——满足单台测序仪一周的本地数据缓存需求

-

静音设计:液冷散热系统,≤35dB噪音——适合放置在临床实验室环境

三、可回收火箭与太空数据中心:极端环境下的计算架构

技术突破点

SpaceX星舰(Starship)的完全可回收技术将发射成本从$1000/kg降至$100/kg以下,这使得轨道数据中心(Orbital Data Center)在商业上变得可行。ARK预测,太空AI算力成本将比地面低25%,主要得益于:

-

无限的太阳能供电(不受电网限制)

-

天然的液冷环境(3K宇宙背景辐射)

-

免于土地审批与地缘政治风险

工程计算挑战

火箭设计阶段:

-

计算流体力学(CFD):超燃冲压发动机与再入大气层的热防护模拟,涉及高超声速湍流与化学反应非平衡流

-

结构有限元分析(FEA):不锈钢舰体在极端温差下的疲劳分析(ANSYS Mechanical/Abaqus)

-

飞行控制算法:基于强化学习的着陆姿态控制,需要实时求解非线性模型预测控制(NMPC)问题

太空数据中心运维:

-

抗辐射加固(Radiation Hardening):低地球轨道(LEO)的高能粒子需要ECC内存与三模冗余(TMR)计算

-

热管理仿真:微重力环境下的两相流热管模拟(OpenFOAM/CFX)

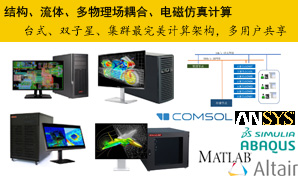

软件工具清单

# 航天工程软件栈 CFD仿真:ANSYS Fluent, OpenFOAM, CFD++, FUN3D (NASA开源) 结构分析:ANSYS Mechanical, Abaqus, Nastran, LS-DYNA (冲击分析) 飞行控制:MATLAB/Simulink, dSPACE, NASA GMAT (轨道设计) 多物理场:COMSOL Multiphysics (电磁-热-结构耦合) CAD设计:Siemens NX, CATIA, SolidWorks硬件配置方案

场景E:火箭发动机设计与仿真(重型CFD/FEA)

-

机型:UltraLAB GX670M 多物理场仿真超算工作站

-

CPU:2× Intel Xeon 6762P(64核/128线程,3.9GHz睿频)——高主频加速稀疏矩阵求解

-

GPU:4× RTX Pro 6000 Blackwell——支持大规模GPU加速CFD(ANSYS Fluent GPU求解器)

-

内存:1.5TB DDR5-5600——支持千万级网格节点的瞬态CFD计算(单精度+双精度混合)

-

存储:RAID 5阵列(4× 7.68TB NVMe企业级SSD)——确保大容量结果文件(单算例可达TB级)的安全性与读写速度

-

显示:双路RTX Pro 6000支持8K多屏输出——用于超大规模网格的可视化后处理

场景F:太空数据中心地面控制系统

-

机型:UltraLAB GX660 高可靠工控服务器

-

CPU:2× Intel Xeon Gold 6530(32核,2.1GHz)——强调稳定性与ECC内存支持

-

专用卡:NVIDIA BlueField-3 DPU(数据处理器)——卸载网络、存储与安全虚拟化负载

-

冗余电源:2+1冗余2000W钛金电源——模拟太空级可靠性要求

-

抗干扰设计:全屏蔽机箱与电磁兼容(EMC)优化——适应航天测控环境的强电磁干扰

四、无人驾驶(Robotaxi):具身智能的端到端算力闭环

算法架构演进

自动驾驶正从模块化 pipeline(感知-预测-规划-控制)向端到端大模型(End-to-End)跃迁。特斯拉FSD V12与Waymo的EMMA模型代表了这一趋势:

关键技术栈:

-

BEV(鸟瞰图)感知:基于Transformer的环视摄像头特征融合,生成统一3D环境表达

-

占用网络(Occupancy Networks):3D体素级别的环境占据预测,替代传统的3D边界框检测

-

世界模型(World Model):基于Video Diffusion的未来场景预测(Waymo的EMMA与特斯拉的World Model)

-

强化学习决策:在CARLA/LGSVL仿真环境中训练策略网络,处理长尾场景(Corner Cases)

计算特征

-

传感器数据洪流:L4级Robotaxi每日产生2-5TB数据,包含摄像头(8MP×11)、激光雷达(64线×5)、毫米波雷达与高精定位(RTK/IMU)

-

实时性硬约束:感知-决策循环必须在100ms内完成,要求确定性低延迟(Deterministic Latency)

-

车云协同:影子模式(Shadow Mode)需要车端触发器与云端训练集群的实时闭环

软件生态

# 自动驾驶开发栈 仿真平台:CARLA, NVIDIA Omniverse, LGSVL, AWS RoboMaker

感知框架:OpenPCDet (点云检测), MMDetection3D, BEVFusion

规划控制:Apollo Cyber RT, Autoware, ROS2 Galactic

地图标注:PointPillars, DeepRoute

数据标注:Scale AI, Labelbox

模型部署:TensorRT, ONNX Runtime, Qualcomm SNPE (车端)硬件配置方案

场景G:自动驾驶研发数据中心(端到端模型训练)

-

机型:UltraLAB Gmax668

-

GPU架构:8× NVIDIA H100 ——支持BEVFormer++与Occupancy Network的大规模并行训练

-

CPU:2× AMD EPYC 9654(96核/192线程)——支撑数据加载与预处理流水线

-

存储:100TB全闪存阵列(Pure Storage或NetApp AFF)——支撑PB级自动驾驶数据集的随机读取(IOPS>500K)

-

时间同步:Precision Time Protocol (PTP) 授时服务器——确保多传感器数据融合的时间一致性

-

网络:NVIDIA Spectrum SN4000交换机(400GbE)——支撑模型并行训练中的梯度同步

场景H:车规级仿真测试平台(SIL/HIL测试)

-

机型:UltraLAB GX660仿真工作站

-

GPU:4× RTX 6000 Ada(同步锁相功能)——支持NVIDIA DriveSim的多摄像头同步渲染(用于摄像头在环测试)

-

FPGA加速卡:Xilinx Zynq UltraScale+(可选)——模拟毫米波雷达的实时回波生成

-

实时系统:RT-Linux内核与PREEMPT_RT补丁——确保仿真步长≤1ms的硬实时约束

-

接口扩展:支持CAN FD、LIN、Ethernet AVB——与真实车辆ECU的直接接口

五、区块链与机器人:分布式算力与具身智能的硬件底座

区块链计算特征

尽管ARK报告中公共区块链着墨较少,但AI与区块链的融合(如去中心化AI训练市场)正在兴起:

-

零知识证明(ZKP):zk-SNARKs/zk-STARKs的生成需要大规模并行MSM(多标量乘法)与FFT运算,GPU加速比CPU高100倍+

-

智能合约执行:以太坊Layer2的EVM等效性要求高性能状态机执行

硬件方案:UltraLAB CX系列配备多路RTX 4090,专用于ZKP证明生成与区块链节点验证。

人形机器人计算架构

具身智能(Embodied AI)要求端侧大模型(Edge LLM)与运动控制的异构融合:

-

端侧模型部署:在NVIDIA Jetson Thor(200 TOPS INT8)或高通RB3 Gen2上运行蒸馏版LLM(如Phi-3/Mistral 7B)

-

实时控制循环:基于ROS2的实时运动控制(1kHz控制频率)与基于Transformer的高层级任务规划(10Hz)的异构调度

硬件方案:UltraLAB EdgeAI系列嵌入式工控机,支持-40℃~70℃宽温运行,配备TPU/NPU加速棒。

六、综合算力基础设施架构建议

面对五大平台的融合趋势,科研单位与企业应构建"云-边-端"分层算力架构:

| 层级 | 功能定位 | 推荐配置 | UltraLAB方案 |

|---|---|---|---|

| 云端 | 大模型训练、基因组联合分析、CFD超算 | 液冷GPU集群+并行存储 | ClusterCluster G8000系列 |

| 边缘 | 工厂质检、医院影像AI、自动驾驶仿真 | 静音工作站+大显存GPU | GA660M/GT430M系列 |

| 终端 | 机器人控制、车载计算、现场测序分析 | 宽温嵌入式+低功耗加速 | EdgeAI Box系列 |

关键技术趋势与硬件投资方向

-

内存墙突破:随着AI模型参数与基因组数据规模增长,CXL(Compute Express Link) 内存扩展技术将成为标配。建议选择支持CXL 2.0的主板平台(如Intel Sapphire Rapids/AMD Turin),实现TB级内存池化共享。

-

液冷标准化:对于≥500W的GPU(如B100/H100),传统风冷已无法满足散热需求。UltraLAB全系列支持冷板液冷(Cold Plate)与浸没式液冷(Immersion Cooling)方案,PUE可降至1.1以下。

-

存算一体:针对生物信息学的内存密集型计算,建议配置Intel Optane PMem 300系列(持久内存)或CXL内存池,消除从SSD加载参考基因组(Reference Genome)的IO瓶颈。

-

量子计算就绪:虽然量子计算尚未成熟,但混合量子-经典算法(VQE/QAOA)需要经典计算端的预处理与后处理。建议预留量子计算接口(如AWS Braket SDK本地环境)。

结语:算力即新石油,架构决定未来

木头姐预言的"大加速"并非抽象概念,而是建立在算力成本曲线与软件算法效率双重提升的基础之上。当AI Agent需要处理55分钟以上的长线任务,当基因测序数据以EB级(Exabyte)累积,当星舰将数据中心送入太空——这些场景共同指向一个事实:没有高性能计算架构的支撑,技术革命将止步于理论。

作为科研与工程领域的算力基础设施提供者,UltraLAB的GX系列(GPU加速)、GA系列(静音高性能)、ClusterCluster系列(大规模集群)正是为这五大前沿科技场景量身定制。在算法迭代周期以月为单位计算的今天,选择具备横向扩展能力(Scale-out)与纵向加速能力(Scale-up)的异构计算平台,将是科研机构与企业捕获"大加速"红利的关键基础设施投资。

关于UltraLAB UltraLAB专注高性能计算工作站与服务器定制,为AI研究、生物信息学、CAE仿真、量化金融等领域提供算法-软件-硬件协同优化的全栈解决方案。针对本文所述五大前沿科技场景,我们提供从单机静音工作站到百节点液冷集群的完整产品矩阵,支持Ubuntu/RHEL/CentOS等科研常用系统的深度优化与预装。

UltraLAB图形工作站供货商:

西安坤隆计算机科技有限公司

国内知名高端定制图形工作站厂家

业务电话:400-705-6800

咨询微信号:100369800